【新創園地專欄-王仁甫】AI革命下的創新者之路:從監理沙盒至創新實踐

人工智慧(AI)的崛起不只於技術領域掀起了巨大的浪潮,更於產業創新、法律制度及社會等多面向,引發深遠的變革。尤其是對產業創新及新創企業的影響,更是顯著而複雜,故本文將探討此影響議題,並簡要分析歐盟《人工智慧法》第53條的監理沙盒體制,提出我國的相關建議。

人工智慧(AI)的崛起不只於技術領域掀起了巨大的浪潮,更於產業創新、法律制度及社會等多面向,引發深遠的變革。尤其是對產業創新及新創企業的影響,更是顯著而複雜,故本文將探討此影響議題,並簡要分析歐盟《人工智慧法》第53條的監理沙盒體制,提出我國的相關建議。

AI技術對產業發展之影響

根據商業趨勢和展望調查 (Business Trends and Outlook Survey, BTOS) :美國只有3.8%的企業使用人工智慧(以下簡稱:AI)技術生產商品和服務,但人工智慧在資訊和科技領域[1]高於美國企業的平均平均值,而有6.5%的企業計劃在未來6個月內使用AI技術,顯見產業導入AI技術將快速成長;而AI技術的快速發展,將改變產品技術創新的本質,及重新塑造商業服務、模式及活動的創新流程(詳見表1)。

表 1 AI技術對組織的影響

|

類型 |

AI技術的投入 |

|

組織 |

(1) 增加AI研發人才 (2) 加速知識創造和技術外溢 (3) 提高學習及吸收能力 |

|

產品 |

(1) AI分析客戶行為進行客製化的產品創新 (2) 利用AI演算法降低生產成本(流程創新) (3) 使用AI技術讓激進式或破壞式創新實踐 |

|

服務 |

(1) 使用AI聊天機器人解決客戶問題 (2) AI分析客戶回饋意見,以建構服務創新 (3) 利用AI技術改善服務流程 (4) AI分類客戶達成智慧行銷 |

資料來源:本研究彙整

前者,AI影響技術創新的機制為,組織為應用AI進行技術創新,將增加投入研發人才,加速知識創造和技術外溢、提高學習及吸收能力,以加速技術創新(Liu, J. et al. 2020)[2]。其中,企業亦會利用AI的演算法分析客戶行為,進行客製化的產品創新、降低生產成本(流程創新),實踐激進式或破壞式創新。

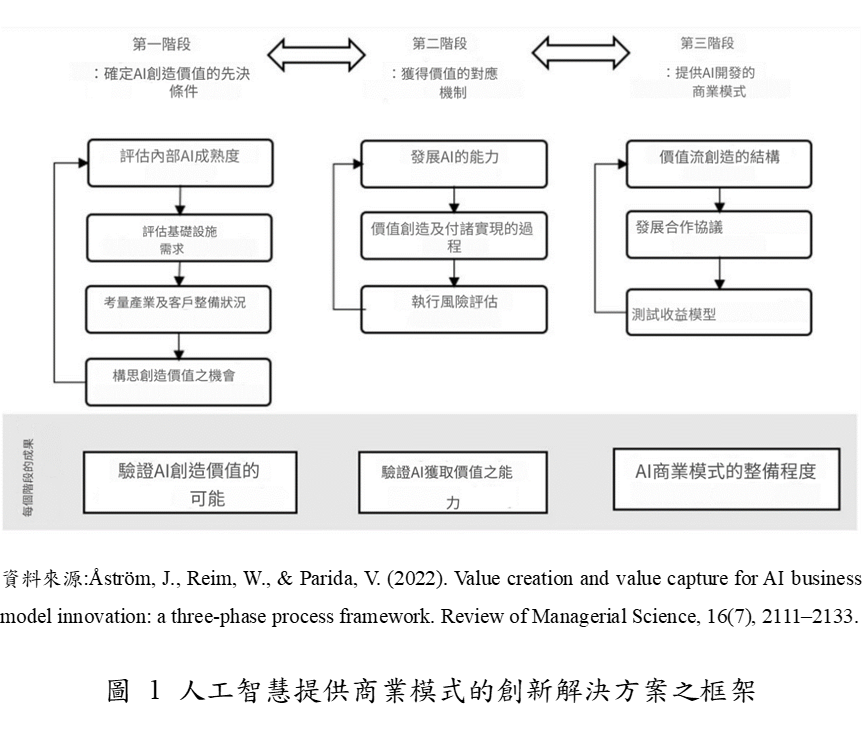

學理將AI技術提供商業服務(或商業模式)創新分為三個階段(Åström et al. 2022[3]),即確定AI創造價值的先決條件、獲得價值的對應機制,及提供AI開發的商業模式(詳見下圖1):

第一階段:提供人工智慧創造價值所需的條件,包含成熟度評估、環境(基礎設施)、客戶(供應鏈)整備及創造價值的方法。

第二階段:建構AI技術創造及價值獲取間的橋樑,須衡量AI導入的能力,及進行風險評估,例如可能產生的資安問題,進而將AI創造價值的機會連結目標客戶群的需求。

第三階段:旨在使用AI技術開發和獲取商業價值的手段,包含彙整AI所創造的價值流,包含內部的商業流程改善、外部組織的合作,並需要測試AI所創造的收益是否顯著的增加。當然,此階段需要考慮到前述的各階段,改善的AI導入的技術與方法。

主因,AI演算法提供了嘗試性的解決方案,但仍需要人類的解釋和行動才能創造實際價值。此外,AI的應用還使供應商能夠更好地理解客戶需求,從而創造更貼近客戶所需的價值。

AI技術發展的資安風險

AI快速導入產業的發展趨勢,也加劇了敵對國家或黑帽駭客組織利用AI技術進行攻擊的可能性,故須重新審視資安防禦的縱深模式[4];Sangwan et al.(2023)[5]研究指出資安與AI相關的英文期刊文獻已約有1,366篇,其中有415篇與工程有關,主要在於研究網路攻擊對資安防禦弱點及機制,重點如下:

- 模型建構攻擊:演算法攻擊,包含漏洞、入侵、操縱特徵及模型等。

- 訓練資料階段:容易受到未授權變更、注入或操縱資料或特徵(參數)的攻擊,如資料庫感染惡意程式,亦或傳統的DDoS攻擊,造成阻斷聯邦式學習模式,需要防禦及驗證(完整性)機制,例如資料防止中毒(或注入)機制、對抗式模型、特徵擠壓(減少特徵或參數)及阻止參數未授權變更(轉移)等。

- 推論或測試階段:AI系統可能將偽造的資料歸類為合法資料,而受到操縱攻擊,可使用模型的特徵向量或資料,進行模型反證或重建。

- AI應用的資安風險:

- 使用AI建構下一代惡意軟體(程式)

- 使用AI技術,無效化資安縱深防禦(AI多面向攻擊,使縱深防禦的無效化)

- 使用AI技術進行密碼撞庫的攻擊

- 使用AI技術建立社交機器人(釣魚與認知作戰?)

- 對抗性訓練(或學習)

- AI/ML系統的意外失靈(故障或效能下降)

AI法規的挑戰與機遇

由於AI技術發展過程,除須面臨許多資安風險外,更須解決資料(著作)授權、演算模型穩定及責任歸屬的問題;這些議題不僅會影響組織採用AI應用的可能,更會阻礙AI技術發展。

就此,歐盟於《人工智慧法》第53條中設立監理沙盒機制[6],由政府提供可控的AI應用測試環境,於投入產品市場或服務前,以有限時間內執行開發、測試和驗證,促進AI創新。

不過,AI監理沙盒機制不得影響主管機關的原監督和糾正權力, 例如該類系統的開發和測試過程中,若發現對健康、安全和基本權利具重大風險時,應立即提出應變或緩解措施;否則,政府將暫停開發和測試過程,直到此問題獲得解決。若該AI應用測試過程中對第三方已造成的任何損害,應承擔侵權及損害賠償等責任。

因此,歐盟《人工智慧法》第53條的立法框架,是希望利用監理沙盒加速AI法外創新轉化成合法應用,但在實踐中也面臨著許多挑戰。例如,歐盟各國的沙盒機制仍存在著法規排除不足、監理機關不一致等問題,導致此創新機制的阻礙。

因此,監理沙盒的目的、性質和效益也需要更清晰的界定和評估,以確保其能夠真正促進創新,而不是成為跨政部門間的緩衝機制。

台灣AI法規與監理沙盒的建議

去(2023)年8月我國行政院發布通過「行政院及所屬機關(構)使用生成式AI參考指引(草案)」,宣示立法的框架也聚焦於七大面向,包含AI法律名詞定義、隱私保護、資料治理、AI風險管控、AI倫理原則規範、產業推動,以及AI應用的遵法與合法性等[7]。

本文建議應將監理沙盒概念納入該AI參考指引,並將機制列入未來AI法規的重要部分。但政府仍須回顧過去已有推動過的部分監理沙盒機制,除探討所遭遇的困難外,更應盤點以下議題,以提升AI法規對創新及創業的支持強度:

- 盤點過往沙盒機制所遇到過的困難,例如創新或創業相關業者為何不太敢進沙盒機制?

- 監理沙盒機制是要採跨部會單一窗口機制,或單一部門主導機制?

- 過去的企業於沙盒機制中,多數選擇試作,而不挑戰機構的監理,使得相關法規無法進行修正,應提出對應策略。

- 監理沙盒是否均應有對應補助計畫?

- 沙盒的目的是什麼?是法規驗證?還是修改法規?還是修改機制?還是讓產業創新作階段試作?抑或於場域中取得創新者的身分?

未來,政府也須與AI沙盒中的創新企業經常合作與對話,使用更加動態和靈活的監理機制,針對不同類型的創新進行分層次的支持及管理,以不斷優化該法規環境,提供更加有利的AI的發展和應用保障制度。

[1] https://www.census.gov/library/stories/2023/11/businesses-use-ai.html

[2] Liu, J., Chang, H., Forrest, J. Y.-L., & Yang, B. (2020). Influence of artificial intelligence on technological innovation: Evidence from the panel data of china's manufacturing sectors. Technological Forecasting & Social Change, 158, 120142-.

[3] Åström, J., Reim, W., & Parida, V. (2022). Value creation and value capture for AI business model innovation: a three-phase process framework. Review of Managerial Science, 16(7), 2111–2133.

[4] 王仁甫(2023),AI產業發達,卻也造成網路攻擊強度升級:資安防禦模式大攻防,思想坦克,網址:https://reurl.cc/eLYVDL

[5] Raghvinder S. Sangwan, Youakim Badr, & Satish M. Srinivasan. (2023). Cybersecurity for AI Systems: A Survey. Journal of Cybersecurity and Privacy, 3(10), 166–190.

[7] 王仁甫 (2023),全球AI法規熱潮:歐盟領先、美國競追、台灣籌備中,思想坦克,網址: https://reurl.cc/K4exdm