【新創園地專欄-王仁甫】從歐美資通安全與法制,探討AI與資安距離

自俄烏戰爭於網路世界提前開打,使得各國政府遭受強大的資安攻擊,各國政府為了因應不斷增高的資安風險,也持續強化資安戰略、法規及各項應變措施,提高數位建設的資安韌性,此外,連帶對總體經濟、企業供應鏈帶來衝擊,導致整體企業撙節資安支出。本文將從歐美資通安全與法制發展趨勢,探討資安、AI之相關對策。

歐盟網路安全局(European Union Agency for Cybersecurity, ENISA)發布「2022年資安威脅態勢 (Cybersecurity threat landscape, ETL)報告」[1]指出,回顧該年歐盟承受8大資安威脅[2],其中又以政府所受攻擊量最大,約占四分之一,再者為數位服務供應商(13.09%)、一般公共服務(12.43%)、服務業(11.78%)及金融業(8.64%)。

其中,因該年俄烏戰爭於網路提前開打,使得各國政府遭受強大的資安攻擊,包含利用系統0 day漏洞進行入侵,並搭配勒索病毒感染,中斷政府及組織的資訊系統維運,估計有60% 的組織受勒索軟體的威脅,且可能已支付贖金;當中,駭客組織最常使用社交工程的方式入侵組織,例如應用網路釣魚技術引誘員工點擊後,安裝後門程式及注入勒索軟體,並利用網路芳鄰共享(Samba)進行擴散。

就此,2023年可以預期的是,隨俄烏戰爭白熱化,將持續推高資安風險,同時衝擊總體經濟,或讓大型企業面臨營收遲滯或下滑風險,進而對中小企業的供應鏈造成營收衝擊,導致整體企業撙節資安支出。

各國政府為了因應不斷增高的資安風險,也持續強化資安戰略、法規及各項應變措施,提高數位建設的資安韌性,包含強化並擴大關鍵基礎設施的資安保護範疇、隱私權優先保障、建構AI法制化及實現供應鏈資安的Zero Trust機制等。

一、強化關鍵基礎設施的資安韌性

2023年歐美均將強化關鍵基礎設施的資安韌性列為修法及戰略落實的重點,說明如下:

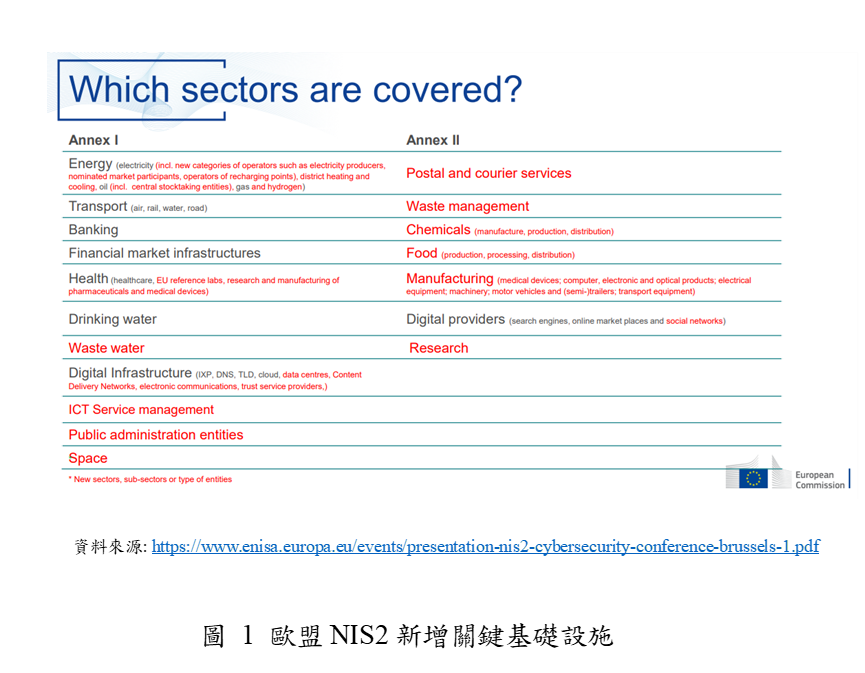

(一) 歐盟NIS2生效執行

2022年底歐盟發布的NIS2(Network and Information Systems 2)指令將取代原指令[3],將於2023年1月16日生效及逐步落實,強化新增的11項關鍵基礎設施[4](詳見圖 1),提升資安監督及報告力道,並統一裁罰標準,以改善歐盟現有的資訊安全態勢:

- 創建必要的網路危機管理架構 (CyCLONe)。

- 提高安全要求和統一報告義務與程度。

- 鼓勵成員國引入新的相關領域,如供應鏈、漏洞管理(列表與通報)、核心聯網和網路(衛生)習慣,並製定其國家網路安全戰略。

- 導入新穎資安概念,例如強化專家參與評審機制,以加強成員國之間的合作和知識共享。

- 通過包括更多的部門來覆蓋更大的經濟和社會部分。

(二)歐盟推動網路韌性相關立法

2023年歐盟將要求資通訊設備符合各種資安要求,包含歐盟網路韌性法草案(The draft European Cyber Resilience Act, CRA) [5]及無線電設備(補充)指令(Radio Equipment Directive, RED),要求有線及無線數位設備均須符合資安規範:

1.歐盟網路韌性法草案

歐盟網路韌性法草案規範資訊軟硬體產品的漏洞改善措施,要求製造商於產品生命週期中,須處理資安相關問題,並要求資安透明度,讓客戶了解各種資通訊產品的資安防護量能,再進行採購,賦予消費者擁有資安選擇權,制定了四個具體目標:

- 確保製造商從設計及開發階段至整個生命週期,提高數位產品的安全性,並要求特定資通訊及資安產品須通過第三方獨立審核[6],但排除部分人體醫療診斷或航太等特別法所規定之資通訊產品[7],若違反將面臨巨額罰款(1,500 萬歐元或年營業額的 2.5%,以較高者為準)[8]。

- 確保完整的網路安全框架,促進軟硬體生產商的合規性。

- 提高數位產品供應鏈及資安透明度,例如包含歐盟骨幹網路建設及接取的供應商資料,及資通訊產品進口的供應鏈資料等,均須能夠追蹤。

- 使企業和消費者能夠安全地使用帶有數位元素的產品。

不過,此法規擬規範開源軟體或作業系統(如Linux)的資安合規機制,將可能對於開源創新產生衝擊,進而提高新創企業之研發成本,值得後續觀察。

2.無線電設備指令修正(補充) (Radio Equipment Directive, RED)

2014年歐盟發布無線電設備指令(The radio equipment directive 2014/53/EU)[9] 確保消費者安全和健康的使用無線電設備,並對無線電頻譜使用與設定建構基本規範。

於2021年10月歐盟執委會(Commission) 修正此指令,將資安及隱私權保護納入無線電設備規範,更強調5G、兒童無線設備(玩具)等資安重要性,例如根據該指令第3(3)(d)、(e)和(f)條規,要求無線設備適用的資安級別,以確保個人資料、個人隱私及防止欺詐等資安防護,並規範該設備不得破壞國家層面的基礎設施,如針對能源領域的分散式智慧電網及電錶應用,提出更高的資安要求。

(三)美國資安戰略將重視韌性

2022年9月美國網路安全暨基礎設施安全局(Cybersecurity and Infrastructure Security Agency, CISA)提出2023年至2025年戰略計畫(Strategic Plan)[10],降低國家基礎設施的資訊安全和實體威脅的風險,並建立資安韌性,有以下幾大重點:

- 採用現代化、安全及韌性資安技術,強化資安事件復原能力,確保網路空間的防禦和韌性;例如2023年財政部編列2.15億美元預算,投入強化資安的帳戶(Cybersecurity Enhancement Account, CEA)保護計畫,以保護敏感機構的系統與資訊[11]。

- 強化雲端安全及資安監控量能。

- 雲端安全的落實。

- 強化資安監控中心(SOC)的量能。

- 要求保存資安日誌記錄、監控及分析。

- 強化國土安全部的資安橫向聯防量能,提生全國資安協作和資訊共享,以降低美國關鍵基礎設施的風險,並增強其韌性;

- CISA針對實體及虛擬安全挑戰,擴大資訊安全、基礎設施安全和緊急通訊等關鍵服務和計劃,將資訊安全服務擴展到非聯邦利益相關者,並調整資安應變(或服務)模式以應對新出現的資安風險。

- 整合CISA的資安職能及量能。

二、AI的資安法規與標準

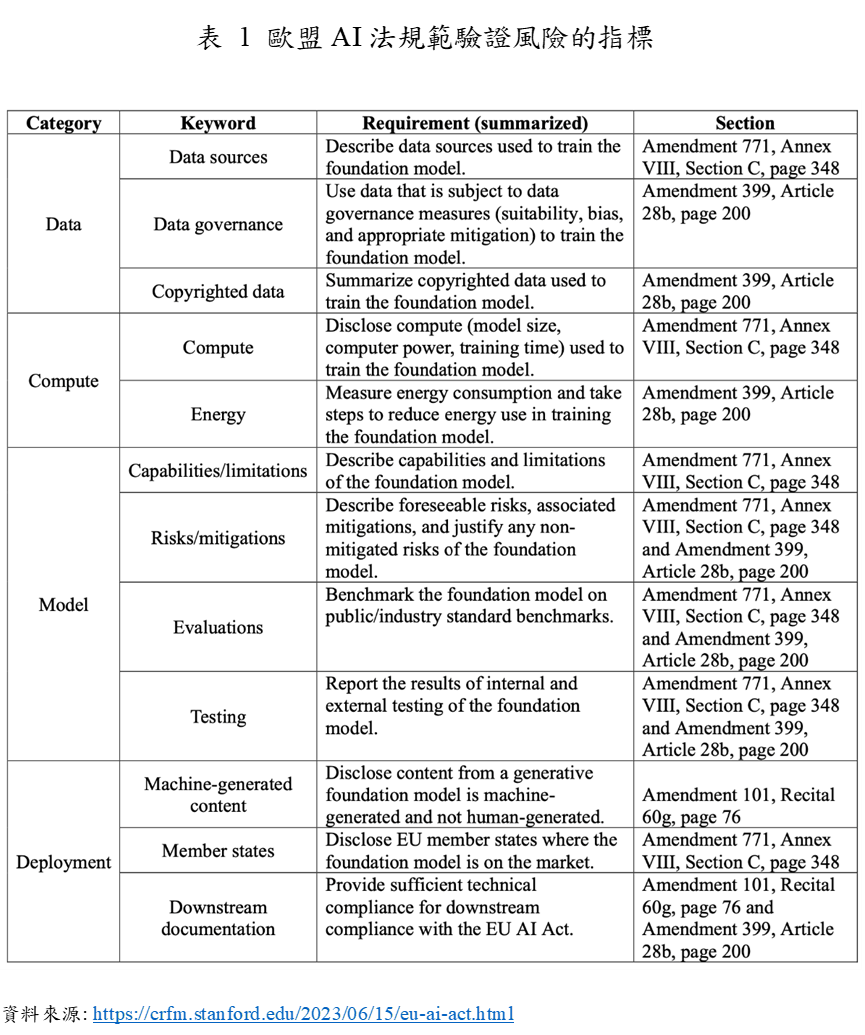

由於,AI與機器學習有黑盒子的問題,無法透明的了解決策、建議或預測的流程(Deeks ,2019)[12],而存在有被私人掌握[13]或無法掌握的高風險,使得AI創新應用影響到社會或國家安全(詳見表 1),故歐美均修AI法律或規範,以進行資安風險控管。

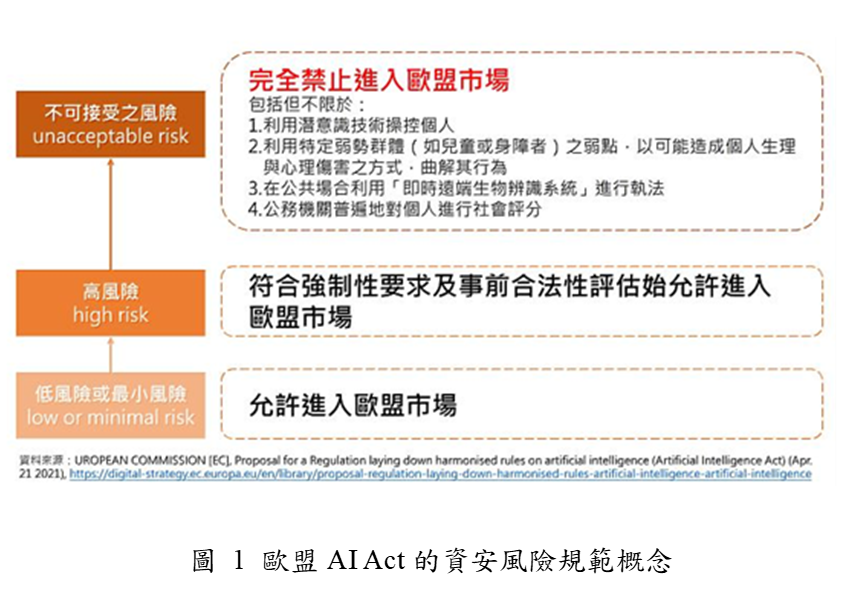

(一)歐盟通過AI法案

2021年4月歐盟提出AI法案,隔年12月歐盟理事會(European Council)通過AI法案共通立場(一般方法)[14],規範AI使用者能尊重基本權,將風險等級分為不可接受之風險、高風險及低風險,並明令不可接受之風險之AI技術及應用完全禁止進入歐盟市場;而高風險之AI技術及應用則應符合強制性要求,及事前合法性評估始允許進入歐盟市場(詳見圖 2),以更安全及合法的方式運用AI,重點如下:

表 1 AI創新應用對社會安全及國家安全挑戰

|

AI應用 |

創新應用 |

社會安全及國家安全挑戰 |

|

AI應用於社會治安 |

|

|

|

AI應用於金融穩定 |

|

|

|

AI應用於認知作戰 |

|

|

|

AI應用於軍事行為 |

|

|

資料來源:本研究彙整

1.AI高風險分類中的調整重點

- 於AI法第5條中將禁止政府運用AI進行社會評分的範疇,擴大至民間或斯私人部門。同時,也禁止運用AI分析社會或經濟原因等弱勢人群,更禁止於公共場所執行即時性的遠程生物辨識系統(Real-time remote biometric identification systems)。

- 法規附件三中的高風險AI運用清單,刪除三大執法部門的AI工具,允許使用AI進行深度偽造檢測、犯罪分析及驗證護照等證件的真實性,但調整人壽和健康保險的AI運用規則。

2.AI參與者的責任及價值鏈保護

- AI運用者須注意數據的品質及技術。

- 於第13條及14條中允許提供者和用戶更有效的合作。

3.建構通用AI系統(General purpose AI systems)

- 此法4b(1)中規範高風險AI也適用通用AI系統,但須評估該系統和相關價值鏈的具體特徵、技術可行性和市場概況,具體說明其應用於通用AI系統及技術發展之範疇。

- 實施法案時,確保成員國參與,及針對上開法規適用,有最終決定權。

4.排除國家安全AI運用限制

於此法第2條中明確將國家安全、國防和軍事目的排除在 AI 法的範圍之外。

5.限制委員會於通過及實施法案的裁量權

- 第 41 條進行了完整審查,以限制委員會於通過及實施法案的裁量權,為高風險AI系統和通用AI系統建立通用技術規範。

- 委員會創設三個小組作為平臺,包含AI利害關係人溝通小組、市場監督小組及通知小組,以強化法案治理及執行的一致性。

- 第68a和68b條完善AI治理框架,包含第68a 條要求委員會在AI領域指定一個或多個聯盟成立測試機構,因應委員會或市場監督機構的要求,提供獨立的技術或科學建議,而第 68b 條規定委員會應創建一個中央獨立專家資料庫,以支持AI法案的執法活動。

- 第58a條規定了AI委員會的義務:如制定AI應用指南

2023年6月14日歐洲議會已表決通過「人工智慧法案(E.U. AI Act)」,但該法案仍需與歐洲理事會協商。

(二)美國以政策及規範控管AI風險

美國於歐巴馬政府時代(2009年至2017年),發布了兩份AI報告,著重於分析AI科技發展對美國勞動力之影響,至川普政府時代(2017年至2021年)開始進入AI政策推動期,於2019年2月川普總統簽署了「保持美國於AI領域的領導地位(Maintaining American Leadership in Artificial Intelligence)」行政命令,提高美國政府AI競爭力的戰略,制定了五個大支柱,分別為投資、資料共享、標準和監管、人培及國際參與[15]。

1.AI權利法案藍圖

2022年10月美國白宮科技政策辦公室 (OSTP) 發布AI權利法案藍圖(Blueprint for an AI Bill of Rights)[16],將前述的支柱概念落實:

(1)安全有效的系統(Safe and Effective Systems)

-

- 保護個人免受不安全或無效AI的侵害。

- 公眾和專家進行積極和持續協商、風險識別和緩解及監督。

- 避免AI使用不適當、低質量或不相關的數據,以避免反向循環、複合危害和不準確的成果。 值得注意的是,藍圖建議藉由第三方的獨立評估和報告,評估AI系統的安全性和有效性。

(2)保護和避免演算歧視(Algorithmic Discrimination Protections)

-

- 受法律保護的個人特徵,不應受到AI歧視,故應以公平的方式設計和使用系統。

- 透過獨立評估報告,確認是否有潛在演算法歧視之可能。

(3)資訊隱私(Data Privacy)

-

- AI使用數據應該合乎合理期待。

- AI設計應納入隱私保護,包括建構系統生命週期評估隱私風險、數據使用最小化原則,及主動識別和減輕隱私風險。

- 應強化監督AI監視及監測系統,即不應於住房、教育或就業等個資進行AI監視,或須於民主機制監督下使用AI。

(4)通知和解釋(Notice and Explanation)義務

-

- 通知當事人和解釋使用AI的保護措施。

- 根據使用者的預期,調整AI數據運用目的,如於高風險隱私資料或系統使用前,向當事人解釋其使用目的及給予摘要報告。

(5)給予人類替代性考量及選擇(Human Alternatives, Consideration, and Fallback)

選擇退出AI的機制,如AI出現故障、產生錯誤,或者個人決定提出異議或退出機制。

2.AI訓練法

美國的國會針對AI提出超過10項的立法[17],但卻只於2022年10月通過了AI訓練法(AI Training Act)[18],要求政府部門提出AI培訓計劃,以提高公務員利用AI創新的能力,降低誤用AI的風險。

(1)該法案要求白宮管理和預算辦公室 (OMB)建立或以其他方式提出AI培訓計劃,以訓練執行機構之採購人員(例如負責項目管理或後勤的人員),但該計畫須確保員工了解AI相關的能力和風險。

(2)OMB須至少每兩年更新一次該計劃,並且確保有一種方法可理解和衡量勞動力參與狀況,並接收和分析計劃參與者之反饋議建。

(3)排除國家安全

3.AI風險管理框架

2023年NIST發布的AI風險管理框架(Artificial Intelligence Risk Management Framework) ,首重隱私權、透明、公平(不歧視)、風險控管(可信度)及利害相關人(參與者)的責任,建構了七項AI資安標準框架:

(1)有效且可靠(Valid and Reliable):客觀的依照證據法則,依照ISO標準(例如ISO 9000:2015),驗證數據、訓練模型、可信度(及精度)、可靠度及穩健性(Robustness;Source: ISO/IEC TS 5723:2022),例如給予AI模型使用條件及時間性,能夠準確且穩定的計算或預測出成果,達成降低人為干預之可能,卻又能控制風險。

(2)安全性(Safe):AI不應威脅人類生活狀態,包含健康、財產或環境等(ISO/IEC TS 5723:2022),故須要:

- 負責任的安全設計、開發、部署及執行AI;

- 部署人員能負責任地安全使用AI系統;

- 部署者和最終用戶能負責任的應用AI決策;

- 針對AI風險進行(分析)說明,能記錄AI事件,獲取證據。

(3)安全及韌性(Secure and Resilient):AI系統必須有資安保護機制,並有韌性應變外部變化,以保持CIA特性,對抗中毒、未授權存取、訓練資料或智慧財產權洩漏等事件。

(4)可責及透明(Accountable and Transparent):可責性是以透明為前題,使可責性涵蓋AI系統的生命周期,由訓練資料來源、模型開發者至使用者等,均須能透明及負責,以保護智慧財產權,針對AI的錯誤性,提出補救措施。

(5)可解釋性(Explainable and Interpretable):AI從輸入資料、計算、運行及產出數據,均須具解釋性,以分析系統功能的可性度,及AI的潛在風險和管理(治理)措施。

(6)強化隱私權保護(Privacy-Enhanced):發展強化隱私權技術(Privacy-enhancing technologies, PETs),包含資料最小化方法、公平性(降低少數資料造成偏差)及反去識別化等。

(7)公平性(Fair-with Harmful Bias Managed):AI技術從生命周期須踐行公平性原則,不產生有害偏見或歧視的應用,包含不以系統性、計算性或統計性偏袒或歧視個人、團體、社區、組織或社會,而造成危害。

三、小結

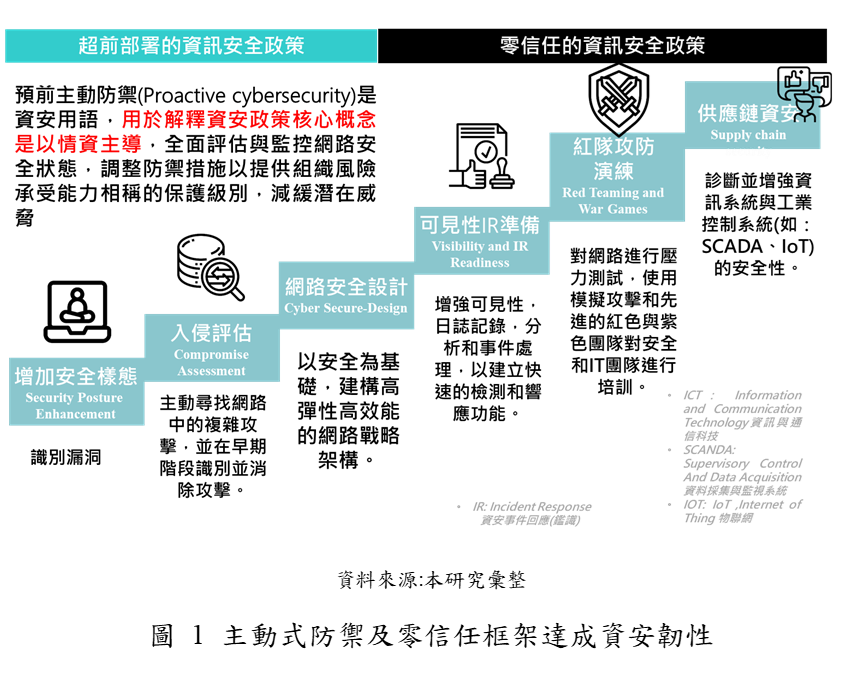

(一)資安韌性能力的建立

隨歐美透過法規或政策建立資安韌性,臺灣政府也提出數位韌性的政策框架[19],從最小資安權限控管,至建立零信任架構資安防護驗證環境,完善網路防禦縱深。

因此,本文彙整上述美歐政策及法規發展,提出主動式防禦及零信任框架,供政府及大型企業建立資安韌性,由資安態樣(組態)、入侵評估置及網站設計,以情資為導向,監控資安系統,進一步透過資安事件應變、紅隊演練驗證及外部供應鏈資安風險控管,達成零信任架構,詳見圖 3。

(二)AI創新的風險衡量

我國雖然還未有AI的立法,但因為歐盟已通過AI立法,故可預期的是美、臺及其他國家亦會參考歐盟之立法意旨,提出本國立法,以進行法律界接。所以,未來企業進行AI創新應用,必須先衡量AI技術的風險,並提出相對證據,以利該創新應用推展至全球。

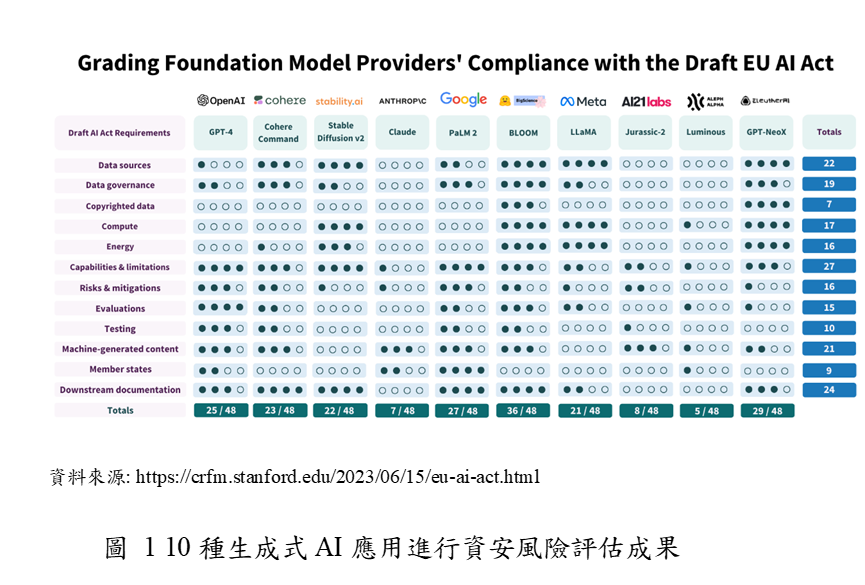

就此本文,建議可依照Stanford大學的研究方法[20],由22項該歐盟規範AI提供者中,選擇12項評估風險(詳見表 2),並針對市場上最熱門的10種生成式AI應用進行資安風險評估(詳見),包含:

1.資料資源(3項要求)

2.計算資源(2項要求)

3.模型本身(4項要求)

4.部署實踐(3項要求)

此研究發現,市面的熱門AI應用於四個項目得分較低且風險較高,分別是資料或數據的著作權保護、計算(能源)衡量、風險緩解措施及風險評估(測試)不足,舉例來說,當AI應用供應商無法突出完整的風險緩解措施時,將可能導致AI創新使用於惡意(如發展駭侵技術)或傷害人類等應用,進而對社會或國家造成系統性風險

同時,未來企業應用或研發AI科技時,也必須確認AI模型的透明度評估,例如:訓練基礎模型的資料揭露、模型在標準基準測試中的表現及部署方式。

[1] 資料來源:https://www.enisa.europa.eu/topics/cyber-threats/threats-and-trends

[2] 包含:(1) 勒索軟體、(2) 惡意程式、(3) 社交工程威脅、(4) 資料安全威脅、(5) 拒絕服務攻擊、(6) 網路威脅、(7) 假訊息、(8) 供應鏈攻擊

[3] Liu(2022),在戰爭爆發時守住醫院與電網!歐盟全新資安指令怎麼抵禦新形態戰爭?,科技報橘,資料來源(最後查詢:2023年4月3日):https://buzzorange.com/techorange/2022/12/30/eu-nis-2/

[4] 能源基礎設施增加涵蓋至所有區域性供熱、冷卻設施,以及氫能源相關機構。而在數位基礎設施則增加資料中心服務供應商、內容傳遞網路(CDN)服務供應商,以及電網、電訊通信營運部門。同時,也新增納管水利設施、政府行政部門等範圍。

[6] 例如作業系統(Linux)、微處理器、Grub、網路接取(以太網路、WiFi)、遠端訪問軟體 (RDP)、補丁管理系統、防火牆、路由器、數據機、瀏覽器(Chrome、Firefox)、網路流量監控系統、微控制器、公(金)鑰基礎設施、虛擬專用網路等。

[7] The proposed Regulation will not apply to products with digital elements within the scope of Regulation (EU) 2017/745 [medical devices for human use and accessories for such devices] and Regulation (EU) 2017/746 [in vitro diagnostic medical devices for human use and accessories for such devices].

[8] 資料來源:https://berthub.eu/articles/posts/eu-cra-secure-coding-solution/

[9] 資料來源: https://single-market-economy.ec.europa.eu/sectors/electrical-and-electronic-engineering-industries-eei/radio-equipment-directive-red_en

[10] 資料詳見(最後查詢日2023年6月20日):https://www.cisa.gov/sites/default/files/2023-01/StrategicPlan_20220912-V2_508c.pdf

[11] 資料詳見(最後查詢日2023年6月20日):https://home.treasury.gov/system/files/266/04.-CEA-FY-2023-CJ.pdf

[12] Deeks. (2019). THE JUDICIAL DEMAND FOR EXPLAINABLE ARTIFICIAL INTELLIGENCE. Columbia Law Review, 119(7), 1829–1850

[13] 例如對法院而言,必須若將AI當作普通法判決的工具,那麼法律必須確定可解釋人工智慧 (explainable AI, xAI)的性質與形式,以在不同的法律背景下,建立起法推理,而能對個案細節作出正確的裁判。同時,法院也必須考量xAI技術,被私人企業掌握的相關風險。

[14] 資料詳見(最後查詢日2023年6月20日):https://www.consilium.europa.eu/en/press/press-releases/2022/12/06/artificial-intelligence-act-council-calls-for-promoting-safe-ai-that-respects-fundamental-rights/?fbclid=IwAR35LjokHsV_1pKh3cG5-qj0s5NBWvB5YzyAUGufrM_5hwLvBC_M-_V7jGc

[15] 資策會科法所(2019),川普簽署行政命令以促進美國AI領域的發展,科法所網頁:https://stli.iii.org.tw/article-detail.aspx?no=64&tp=1&d=8228

[17] 1. H.R.7296 — 117th Congress (2021-2022) GOOD AI Act of 2022

2. S.3035 — 117th Congress (2021-2022) GOOD AI Act of 2021

3. S.1353 — 117th Congress (2021-2022) Advancing American AI Act

4. S.2551 — 117th Congress (2021-2022) AI Training Act

5. S.1257 — 117th Congress (2021-2022) AI Scholarship-for-Service Act

6. H.R.4468 — 117th Congress (2021-2022) AI for Agency Impact Act

7. H.R.7683 — 117th Congress (2021-2022) AI Training Act

8. H.R.6553 — 117th Congress (2021-2022) AI JOBS Act of 2022

9. H.R.4469 — 117th Congress (2021-2022) AI in Counterterrorism Oversight Enhancement Act

10. H.R.3844 — 117th Congress (2021-2022) Fellowships and Traineeships for Early-Career AI Researchers Act

11. H.R.7811 — 117th Congress (2021-2022) AI for National Security Act

[19] 詳見:https://technews.tw/2022/09/21/digital-resilience-for-all/

[20] 詳見:https://crfm.stanford.edu/2023/06/15/eu-ai-act.html